本文目录一览:

做深度学习,需要配置专门的GPU服务器吗?

1、如果你正在构建或升级你的深度学习系统,你最关心的应该也是GPU。GPU正是深度学习应用的核心要素——计算性能提升上,收获巨大。主要任务:承担深度学习的数据建模计算、运行复杂算法。

2、GPU服务器的主要功能是提供强大的计算能力,以加速各种需要大规模并行计算的应用。这些应用包括但不限于科学计算、工程模拟、图像处理、视频处理、深度学习等。

3、如今即使使用GPU的深度学习服务器也要持续数天乃至数月(取决于数据规模和深度学习网络模型),需要使用单独的设备保障,保证训练任务能够小时长期稳定运行。

4、因而,更擅长并行计算和高带宽的GPU,则成了大家关注的重点。很多人认为深度学习GPU服务器配置跟普通服务器有些不一样,就像很多人认为做设计的机器一定很贵一样。

5、深度学习:GPU服务器可以提供计算能力,帮助深度学习算法处理大量数据,从而让机器学习更快、更准确。 渲染:GPU服务器可以让3D渲染更快,提升渲染效率。

6、没有gpu用云服务器运行深度神经网络。深度学习可以理解为深度神经网络进行机械学习,这种情况必须得用GPU,还得好几块,同时还得搭配容量更大的内存,如果没有GPU,用云服务器跑深度学习也可以。

8卡gpu服务器功率要求

1、目前人工神经网络主要在通用计算机上编程来实现,能耗比较高。例如一台计算机的功率大概是200~300 W,一台GPU服务器的能耗至少是2000 W,而人脑的功耗只有20 W。

2、而每块SCSI硬盘消耗的功率也在10瓦特(W)以上,所以服务器系统所需要的功率远远高于PC,一般PC只要200瓦电源就足够了,而服务器则需要300瓦以上直至上千瓦的大功率电源。

3、从表3中我们可以测算出两部硬盘工作时需要37W~56W的功率。另外,由于服务器可 以挂载多个硬盘和安装两个甚至更多的CPU,因此其电源功率理应比家用电脑的电源功率更 大,所以用于服务器的电源往往标称为350W、400W就是这个原因了。

4、r740服务器功率300W或者150w。根据查询相关资料信息,R740服务器增强了对GPU等协处理器卡的支持,最多配置3块300W(双插槽)或者6块150W功率(单插槽)的加速卡。此外,24个内存插槽中支持最多12个NVDIMM。

5、三卡和四卡SLI在WindowsVista、7和8上支持,但不支持Linux。检查现有组件。SLI需要一个具有多个PCI-Express插槽的主板,以及一个具有足够多显卡接口的电源。需要一个输出功率至少800瓦的电源。获取SLI兼容的显卡。

6、稳定后功率一般在400W-600W,但是机架式服务器待机24小时功耗最多不超过30W,机架服务器总耗电量不高于单机柜的供电能力。服务器在现有主流服务器中功耗主要部件有CPU、内存、硬盘、RAID卡、GPU卡、网卡、风扇、主板等。

网站能用gpu服务器吗知乎?

1、因此,选择GPU云服务器还是CPU云服务器取决于具体的应用场景和需求。如果需要处理图形和计算密集型任务,GPU云服务器可能更适合;如果只需要处理一般的计算任务,CPU云服务器可能更经济实惠。

2、一般来说,选GPU云服务器的话,尽量选大厂的会比较好点。因为大厂一般在产品性能和服务上都做得比较好,而且他们比较重视客户体验这一块。你关注的火山引擎的GPU云服务器就很不错,性能稳定,用户口碑也很好。

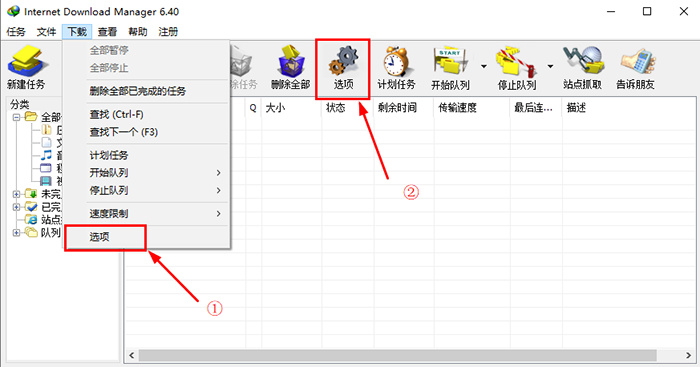

3、安装GPU驱动程序:在使用服务器GPU之前,需要先安装相应的GPU驱动程序。不同型号的GPU需要不同的驱动程序,可以在GPU厂商的官方网站上下载。配置GPU环境:在安装完GPU驱动程序之后,需要对GPU环境进行配置。

4、比如,易学智能,国内厂家,GPU便宜、按小时租,并且预装了各种环境-Tensorflow、Pytorch、MXNet、Caffe等都有,还有很多公开数据集可免费用。服务没得说,技术小哥连bug都帮你找,我当时用着,真是上帝感觉。

5、好的gpu云服务器有腾讯云服务器,阿里云服务器,优刻得,华为云,百度云服务器。

转载请注明:商兜网 » 服务器 » gpu服务器配置(gpu服务器怎么使用)

版权声明

本文仅代表作者观点,不代表B5编程立场。

本文系作者授权发表,未经许可,不得转载。